脑机接口数据处理连载(一)入门:核心概念与技术框架(转载)

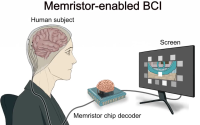

脑机接口(Brain-Computer Interface, BCI)是一种令人兴奋的技术,它能够将大脑活动直接转换为计算机指令,为残障人士提供新的交流方式,也为游戏、医疗等领域带来革命性的变化。本文将带您走进 BCI 数据处理的世界,从核心概念到技术框架,再到实际代码实现,帮助您快速入门这一前沿领域。

1. 核心概念

1.1 脑电信号(EEG)基础

脑电图(Electroencephalography, EEG)是 BCI 最常用的数据来源,它通过放置在头皮上的电极记录大脑的电活动。EEG 信号具有以下特点:

频率范围:0.5-100 Hz

振幅范围:1-100 μV

高时间分辨率(毫秒级)

低空间分辨率

主要的 EEG 信号频段包括:

δ 波(0.5-4 Hz):深度睡眠

θ 波(4-8 Hz):困倦、放松

α 波(8-13 Hz):清醒但放松

β 波(13-30 Hz):警觉、专注

γ 波(>30 Hz):高级认知功能

1.2 常见 BCI 范式

根据信号类型和控制方式,BCI 主要分为以下几类:

运动想象(Motor Imagery, MI)BCI:用户通过想象肢体运动(如左手、右手、脚的运动)来产生特定的脑电信号模式。

P300 BCI:基于事件相关电位(ERP)中的 P300 成分,当用户注意到特定刺激时,在刺激出现约 300ms 后会出现一个正向电位。

稳态视觉诱发电位(SSVEP)BCI:用户注视不同频率闪烁的视觉刺激,大脑会产生与刺激频率同步的脑电信号。

皮层脑电(ECoG)BCI:电极直接放置在大脑皮层表面,提供更高质量的信号,但需要手术植入。

1.3 BCI 数据处理流程

一个完整的 BCI 系统通常包括以下几个处理阶段:

数据采集:通过 EEG 设备记录脑电信号

预处理:去除噪声和 artifacts,增强信号质量

特征提取:从预处理后的信号中提取具有判别性的特征

分类 / 解码:使用机器学习算法将特征映射到特定的用户意图

应用输出:将解码结果转换为实际的应用控制指令

2. 技术框架详解

2.1 数据采集

数据采集是 BCI 系统的基础,需要专业的 EEG 设备。常见的设备包括:

传统有线 EEG 系统(如 Neuroscan, Biosemi)

便携式无线 EEG 设备(如 Emotiv, Muse)

研究级高密度 EEG 系统(64/128/256 通道)

数据采集的关键参数:

采样率:通常 250-1000 Hz

电极数量:从少数几个到数百个不等

参考电极位置

接地电极位置

2.2 预处理

预处理是 BCI 数据处理中至关重要的一步,目的是去除噪声和 artifacts,提高信号质量。常见的预处理步骤包括:

滤波:

高通滤波:去除低频漂移(通常 0.5-1 Hz)

低通滤波:去除高频噪声(通常 30-50 Hz)

陷波滤波:去除工频干扰(如 50 Hz 或 60 Hz)

伪迹去除:

眼电伪迹(EOG):由眼睛运动产生

肌电伪迹(EMG):由肌肉活动产生

心电伪迹(ECG):由心脏活动产生

方法:独立成分分析(ICA)、自适应滤波、阈值去除等

信号标准化:

归一化:将信号缩放到特定范围

标准化:使信号具有零均值和单位方差

2.3 特征提取

特征提取是将原始 EEG 信号转换为更具判别性的特征向量的过程。常见的特征提取方法包括:

时域特征:

均值、方差、峰值、谷值

过零率

波形长度

自回归模型系数(AR)

频域特征:

功率谱密度(PSD)

特定频段的功率(α, β, θ, δ, γ)

频谱熵

小波变换系数

时频域特征:

短时傅里叶变换(STFT)

小波变换(WT)

希尔伯特 – 黄变换(HHT)

空间特征:

脑电地形图

不同电极间的相关性

共同空间模式(CSP)

2.4 分类 / 解码

分类是将提取的特征映射到用户意图的过程。常用的分类算法包括:

传统机器学习算法:

支持向量机(SVM)

线性判别分析(LDA)

人工神经网络(ANN)

k 近邻(k-NN)

决策树和随机森林

深度学习方法:

卷积神经网络(CNN)

循环神经网络(RNN)

长短期记忆网络(LSTM)

深度学习与传统特征提取结合

评估指标:

准确率(Accuracy)

混淆矩阵(Confusion Matrix)

kappa 系数

信息传输率(ITR)

2.5 应用输出

应用输出将分类结果转换为实际的控制指令,常见的应用包括:

轮椅控制

假肢控制

文字输入

游戏控制

神经反馈治疗

3. 实战代码示例

下面我们将通过一个完整的代码示例来演示 BCI 数据处理的基本流程。我们将使用 MNE 库处理一个公开的 BCI 数据集。

3.1 安装必要的库

python

运行

!pip install mne numpy scipy matplotlib scikit-learn

一键获取完整项目代码

3.2 数据加载与探索

我们将使用 BCI Competition IV 的数据集 2a,这是一个运动想象 BCI 数据集。

python

运行

import mne

import numpy as np

import matplotlib.pyplot as plt

from sklearn.preprocessing import StandardScaler

from sklearn.discriminant_analysis import LinearDiscriminantAnalysis

from sklearn.model_selection import cross_val_score, train_test_split

from sklearn.pipeline import Pipeline

from sklearn.svm import SVC

from sklearn.metrics import classification_report, confusion_matrix

# 加载示例数据

# 注意:这里我们使用MNE内置的示例数据,实际使用时需要下载完整数据集

from mne.datasets import bcic4_2a

raw_fname, event_fname = bcic4_2a.data_path()

# 读取原始数据

raw = mne.io.read_raw_edf(raw_fname, preload=True)

events = mne.read_events(event_fname)

# 查看数据基本信息

print(“数据形状:”, raw.get_data().shape)

print(“采样率:”, raw.info[‘sfreq’], “Hz”)

print(“电极数量:”, len(raw.info[‘ch_names’]))

print(“电极名称:”, raw.info[‘ch_names’])

# 查看事件信息

print(“\n事件类型:”, np.unique(events[:, 2]))

print(“事件数量:”, len(events))

# 绘制原始数据的前10秒

raw.plot(duration=10, n_channels=8, scalings=’auto’)

plt.show()

一键获取完整项目代码

3.3 数据预处理

python

运行

# 设置参考电极

raw.set_eeg_reference(‘average’, projection=True)

# 滤波:去除直流分量和工频干扰

raw.filter(l_freq=0.5, h_freq=30, fir_design=’firwin’)

# 陷波滤波去除50Hz工频干扰

raw.notch_filter(freqs=50, fir_design=’firwin’)

# 提取事件相关的时间段

event_id = {

‘left_hand’: 1,

‘right_hand’: 2,

‘foot’: 3,

‘tongue’: 4

}

tmin, tmax = -0.2, 0.5 # 从刺激前200ms到刺激后500ms

# 创建epochs

epochs = mne.Epochs(raw, events, event_id, tmin, tmax,

proj=True, baseline=(None, 0), preload=True)

print(“Epochs形状:”, epochs.get_data().shape) # (n_epochs, n_channels, n_times)

# 可视化不同类别的事件相关电位

epochs[‘left_hand’].average().plot()

epochs[‘right_hand’].average().plot()

plt.show()

一键获取完整项目代码

3.4 特征提取

我们将提取时域和频域特征:

python

运行

# 提取特征:时域特征和频域特征

def extract_features(epochs):

n_epochs, n_channels, n_times = epochs.get_data().shape

features = []

for i in range(n_epochs):

epoch_data = epochs.get_data()[i]

# 时域特征:均值、方差、峰值、谷值

mean = np.mean(epoch_data, axis=1)

var = np.var(epoch_data, axis=1)

peak = np.max(np.abs(epoch_data), axis=1)

trough = np.min(epoch_data, axis=1)

# 频域特征:使用功率谱密度

psd, freqs = mne.time_frequency.psd_array_welch(

epoch_data, sfreq=epochs.info[‘sfreq’], fmin=0.5, fmax=30, n_fft=128

)

# 提取不同频段的平均功率

alpha_power = np.mean(psd[:, (freqs >= 8) & (freqs <= 13)], axis=1)

beta_power = np.mean(psd[:, (freqs >= 13) & (freqs <= 30)], axis=1)

# 组合所有特征

epoch_features = np.concatenate([mean, var, peak, trough, alpha_power, beta_power])

features.append(epoch_features)

return np.array(features)

# 提取特征

X = extract_features(epochs)

y = epochs.events[:, 2] # 事件标签

print(“特征形状:”, X.shape)

print(“标签形状:”, y.shape)

print(“类别分布:”, np.bincount(y))

一键获取完整项目代码

3.5 分类与评估

python

运行

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建预处理和分类的流水线

pipeline = Pipeline([

(‘scaler’, StandardScaler()), # 标准化

(‘lda’, LinearDiscriminantAnalysis()) # LDA分类器

])

# 使用交叉验证评估模型

cv_scores = cross_val_score(pipeline, X_train, y_train, cv=5)

print(“交叉验证准确率: {:.2f} ± {:.2f}”.format(cv_scores.mean(), cv_scores.std()))

# 在测试集上评估

pipeline.fit(X_train, y_train)

y_pred = pipeline.predict(X_test)

accuracy = np.mean(y_pred == y_test)

print(“测试集准确率:”, accuracy)

# 打印分类报告

print(“\n分类报告:”)

print(classification_report(y_test, y_pred, target_names=[‘休息’, ‘左手’, ‘右手’, ‘脚’, ‘舌头’]))

# 绘制混淆矩阵

cm = confusion_matrix(y_test, y_pred)

plt.imshow(cm, interpolation=’nearest’, cmap=plt.cm.Blues)

plt.title(‘混淆矩阵’)

plt.colorbar()

tick_marks = np.arange(len(event_id))

plt.xticks(tick_marks, event_id.keys(), rotation=45)

plt.yticks(tick_marks, event_id.keys())

plt.tight_layout()

plt.ylabel(‘真实标签’)

plt.xlabel(‘预测标签’)

plt.show()

一键获取完整项目代码

3.6 使用 CSP 特征的运动想象分类

共同空间模式(CSP)是运动想象 BCI 中常用的特征提取方法:

python

运行

from mne.decoding import CSP

# 为了简化,我们只选择左手和右手的运动想象数据

epochs_mi = epochs[‘left_hand’, ‘right_hand’]

X_mi = epochs_mi.get_data()

y_mi = epochs_mi.events[:, 2]

# 划分训练集和测试集

X_train_mi, X_test_mi, y_train_mi, y_test_mi = train_test_split(

X_mi, y_mi, test_size=0.2, random_state=42

)

# 创建CSP特征提取器和分类器的流水线

csp = CSP(n_components=4, reg=’ledoit_wolf’, log=True)

lda = LinearDiscriminantAnalysis()

# 训练CSP

csp.fit(X_train_mi, y_train_mi)

# 提取CSP特征

X_train_csp = csp.transform(X_train_mi)

X_test_csp = csp.transform(X_test_mi)

# 训练LDA分类器

lda.fit(X_train_csp, y_train_mi)

# 评估

accuracy_csp = lda.score(X_test_csp, y_test_mi)

print(“CSP+LDA分类准确率:”, accuracy_csp)

# 可视化CSP模式

csp.plot_patterns(epochs_mi.info, ch_type=’eeg’, units=’Patterns (AU)’, size=1.5)

plt.show()

# 可视化CSP过滤后的信号

epochs_filt = csp.transform(epochs_mi)

plt.figure(figsize=(12, 6))

for i in range(4):

plt.subplot(2, 2, i+1)

plt.plot(epochs_filt[y_mi==1, i].mean(axis=0), label=’左手’)

plt.plot(epochs_filt[y_mi==2, i].mean(axis=0), label=’右手’)

plt.title(f’CSP成分 {i+1}’)

plt.legend()

plt.show()

一键获取完整项目代码

3.7 深度学习方法示例

使用 CNN 处理 EEG 数据:

python

运行

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense, Dropout

# 准备CNN输入数据 (n_samples, n_channels, n_times, 1)

X_cnn = X_mi[:, :, :, np.newaxis]

# 划分训练集和测试集

X_train_cnn, X_test_cnn, y_train_cnn, y_test_cnn = train_test_split(

X_cnn, y_mi, test_size=0.2, random_state=42

)

# 将标签转换为独热编码

y_train_onehot = tf.keras.utils.to_categorical(y_train_cnn – 1, num_classes=2)

y_test_onehot = tf.keras.utils.to_categorical(y_test_cnn – 1, num_classes=2)

# 创建CNN模型

model = Sequential()

model.add(Conv2D(32, (1, 5), activation=’relu’, input_shape=(X_train_cnn.shape[1], X_train_cnn.shape[2], 1)))

model.add(MaxPooling2D((1, 2)))

model.add(Conv2D(64, (1, 5), activation=’relu’))

model.add(MaxPooling2D((1, 2)))

model.add(Flatten())

model.add(Dense(128, activation=’relu’))

model.add(Dropout(0.5))

model.add(Dense(2, activation=’softmax’))

# 编译模型

model.compile(optimizer=’adam’,

loss=’categorical_crossentropy’,

metrics=[‘accuracy’])

# 训练模型

history = model.fit(X_train_cnn, y_train_onehot,

epochs=20, batch_size=16,

validation_split=0.2)

# 评估模型

test_loss, test_acc = model.evaluate(X_test_cnn, y_test_onehot)

print(“CNN测试准确率:”, test_acc)

# 绘制训练历史

plt.figure(figsize=(12, 4))

plt.subplot(1, 2, 1)

plt.plot(history.history[‘loss’], label=’训练损失’)

plt.plot(history.history[‘val_loss’], label=’验证损失’)

plt.xlabel(‘Epoch’)

plt.ylabel(‘Loss’)

plt.legend()

plt.subplot(1, 2, 2)

plt.plot(history.history[‘accuracy’], label=’训练准确率’)

plt.plot(history.history[‘val_accuracy’], label=’验证准确率’)

plt.xlabel(‘Epoch’)

plt.ylabel(‘Accuracy’)

plt.legend()

plt.show()

一键获取完整项目代码

4. 挑战与未来发展

尽管 BCI 技术取得了显著进展,但仍面临许多挑战:

信号质量:EEG 信号微弱且易受噪声干扰

个体差异:不同人的脑电信号模式存在很大差异

长期稳定性:BCI 系统的性能可能随时间变化

用户训练:用户通常需要大量训练才能熟练使用 BCI 系统

空间分辨率:头皮 EEG 的空间分辨率较低

未来的发展方向包括:

高分辨率 EEG:增加电极数量,提高空间分辨率

混合 BCI:结合多种信号模态(EEG, EOG, EMG 等)

闭环系统:实时反馈和自适应调整

深度学习应用:端到端的 BCI 系统

非侵入性脑机接口的突破:无需手术即可获得高质量信号

5. 总结与资源推荐

本文介绍了脑机接口数据处理的核心概念和技术框架,包括数据采集、预处理、特征提取、分类和解码等关键步骤。通过实际代码示例,展示了如何使用 MNE 库和机器学习方法处理 BCI 数据。

————————————————

版权声明:本文为CSDN博主「Brduino脑机接口技术答疑」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/m0_63827302/article/details/155226004

![]()